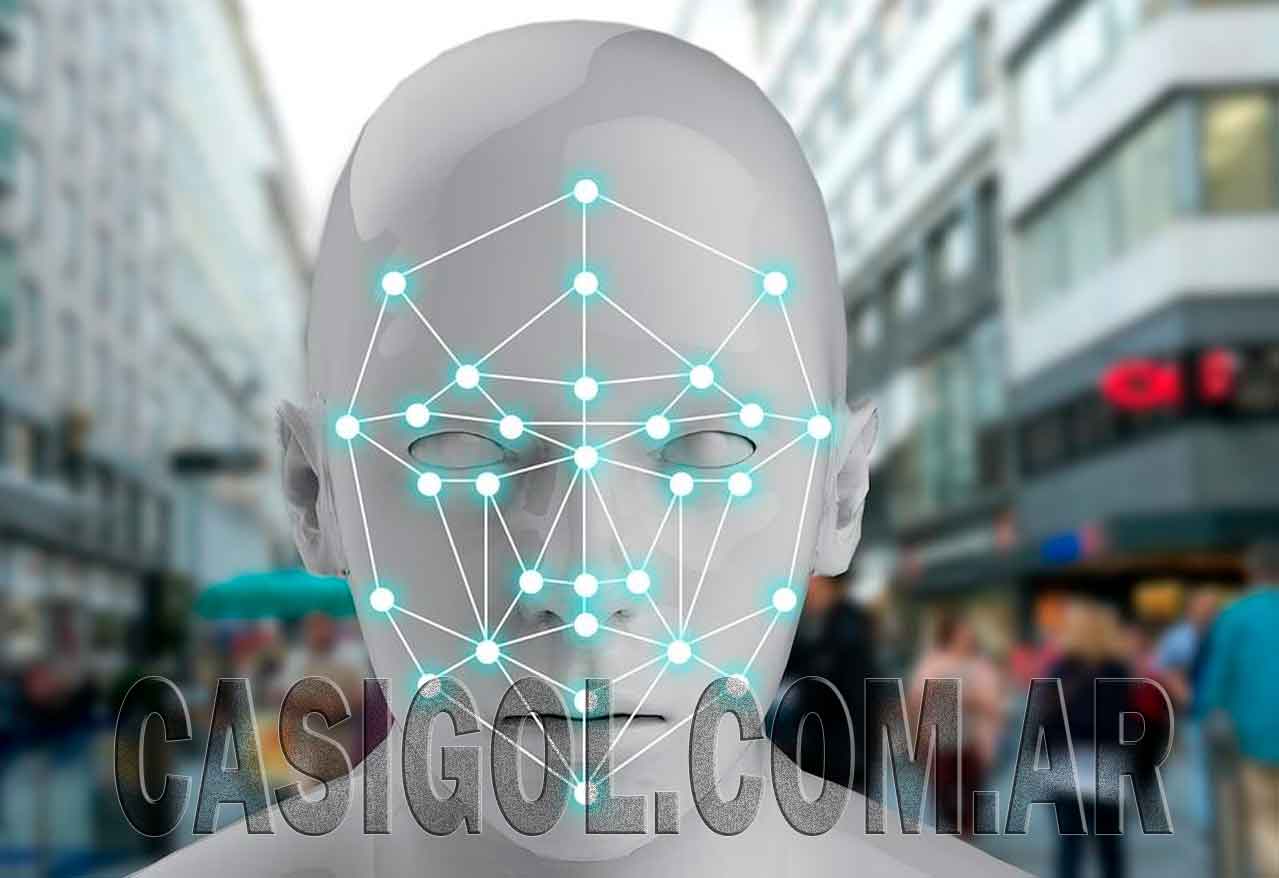

Desde la Tribuna del Pueblo, hoy queremos poner el foco en la advertencia de la matemática Cathy O'Neil sobre el poder de los algoritmos y sus efectos en la sociedad: sistemas que, sin controles ni transparencia, pueden profundizar desigualdades y tomar decisiones que afectan la vida de millones de personas.

¿Qué son las “armas de destrucción matemática” y por qué deberían importarnos?

En un mundo cada vez más atravesado por la tecnología, muchas decisiones importantes ya no las toman personas, sino algoritmos. Detrás de esa realidad aparece una voz crítica: la de Cathy O'Neil, matemática y especialista en datos, autora del libro publicado en 2016, Weapons of Math Destruction (Armas de destrucción matemática).

O’Neil no siempre pensó así. Durante años trabajó dentro del sistema: fue académica, luego analista en finanzas y más tarde científica de datos en empresas tecnológicas. Es decir, conoce desde adentro cómo funcionan los modelos matemáticos que hoy se usan para tomar decisiones sobre millones de personas.

Con el tiempo, empezó a notar algo preocupante: muchos de estos sistemas, que se presentan como objetivos y eficientes, en realidad pueden generar injusticias.

¿Dónde está el problema?

Los algoritmos se usan para definir cosas clave: quién consigue un trabajo, quién accede a un crédito, qué alumnos reciben mejores oportunidades o incluso quién es considerado “riesgoso” por el sistema judicial.

El problema es que:

- No sabemos cómo funcionan realmente (son secretos).

- No se pueden discutir ni cuestionar.

- Y muchas veces están diseñados con datos incompletos o sesgados.

Por ejemplo, si un sistema decide que una persona es “de alto riesgo” por vivir en cierto barrio o tener determinado historial, puede negarle oportunidades. Eso hace que su situación empeore… y el propio algoritmo confirma su predicción. Un círculo difícil de romper.

¿Por qué esto afecta más a los que menos tienen?

Porque estos sistemas suelen apoyarse en datos históricos. Y si en el pasado hubo desigualdades, el algoritmo las aprende y las repite.

Así, quienes ya estaban en desventaja quedan aún más relegados:

- menos acceso a crédito,

- menos oportunidades laborales,

- más controles o sospechas.

Mientras tanto, los sectores más favorecidos quedan fuera de ese tipo de evaluación o salen mejor parados.

¿Y qué tiene que ver esto con la democracia?

Mucho más de lo que parece.

Cuando las decisiones importantes se toman mediante sistemas que nadie puede ver ni entender, el control deja de estar en la sociedad. Los algoritmos pasan a ser una especie de “caja negra” manejada por empresas privadas.

Además:

- Sus códigos están protegidos como propiedad comercial.

- No hay obligación de explicarlos.

- Y en muchos casos, no existen regulaciones claras.

Esto significa que decisiones que afectan a miles o millones de personas pueden tomarse sin transparencia, sin control público y sin posibilidad de defensa.

Una advertencia necesaria

O’Neil no está en contra de la tecnología ni de los algoritmos. Su mensaje es más simple: hay que usarlos con responsabilidad.

Si no existen reglas claras, controles y transparencia, el riesgo es que el poder quede concentrado en pocas manos: quienes diseñan y manejan estos sistemas.

Conclusión

En una sociedad cada vez más digital, no alcanza con confiar en que “los números no se equivocan”. Los algoritmos también reflejan decisiones humanas, intereses y errores.

Por eso, cada vez más voces plantean la necesidad de avanzar en regulaciones que garanticen:

- transparencia,

- control,

- y equidad.

Porque si no se establecen límites, el futuro podría quedar definido por sistemas que nadie eligió… y que muy pocos entienden.